Fordon

Darpa utvecklar system som ska göra självkörande bilar olurbara

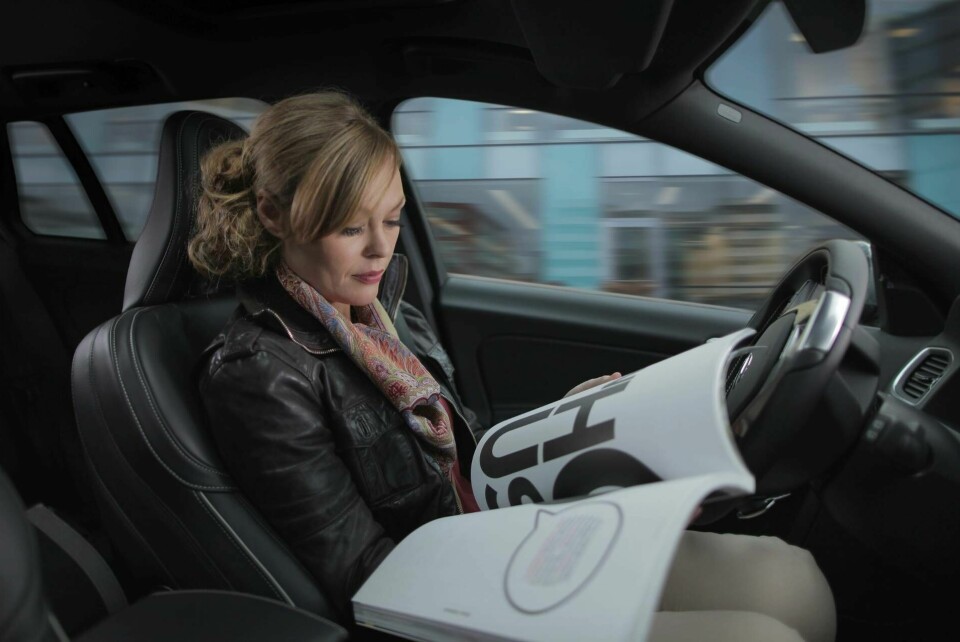

Amerikanska försvarsmyndigheten Darpa ska utveckla ett nytt säkerhetssystem för autonoma fordon. Foto: Volvo Cars

Autonoma bilar beskrivs som en mobilitetslösare – och ett potentiellt säkerhetshot. Nu har amerikanska försvarsmyndigheten Darpa utannonserat att de ska utveckla ett system som gör att man inte kan hacka och lura självkörande bilar

I dag är de stora fordonstrenderna elektrifiering och automatisering. Och varenda biltillverkare pratar om hur de inom kort ska lansera självkörande teknik. Men trots otaliga pilotprojekt och massvis med utveckling – är förtroendet för tekniken fortfarande lågt.

Och ett skäl till att många inte skulle våga sätta sina barn i en självkörande taxi – är för att de upplevda säkerhetsbristerna är för stora. För även om tekniken blir bättre för varje månad som går, så är den fortfarande ganska enkel att lura.

Just detta ska Darpa, Defence advanced researhc projects agency, försöka lösa.

I ett nytt program kallat GARD, Guaranteeing AI Robustness against Deception, är målet att se till att maskininlärningssystem inte ska kunna förvanskas på något sätt.

– Redan i dag har vi inkorporerat maskininlärning på flera olika sätt. Men vi har rusat fram och inte ägnat mycket tanke åt de sårbarheter som finns i maskininlärningsplattformarna. Framförallt när det kommer till att förändra, korrumpera eller lura dessa system, säger Hava Siegelman, programchef för Darpas Information Innovation Office, i ett uttalande.

Som exempel på varför GARD behövs anger Darpa fall där självkörande bilar lurades och trodde att en stoppskylt i själva verket var en 45 mph-skylt. Detta genom väldigt lågteknologisk visuell förändring. Darpa varnar och menar om detta skulle ske i verkligheten skulle konsekvenserna vara ödesdigra.

GARD kommer att inte enbart inriktas mot självkörande bilar, utan inom många områden där maskininlärningsteknik används. Till en början ska man fokusera på bildbaserade system för sedan gå vidare till video, ljud och mer komplexa.

– Det är ett kritiskt behov att utveckla maskininlärningsförsvar eftersom tekniken i allt högre grad implementeras i några av våra mest kritiska infrastrukturer, säger Hava Siegelman.